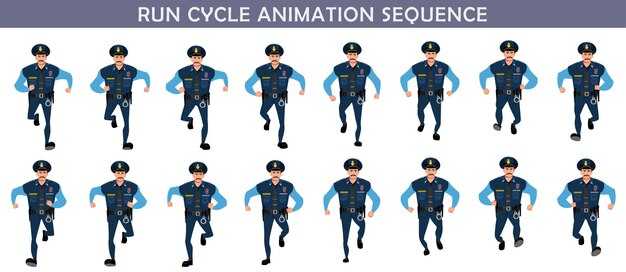

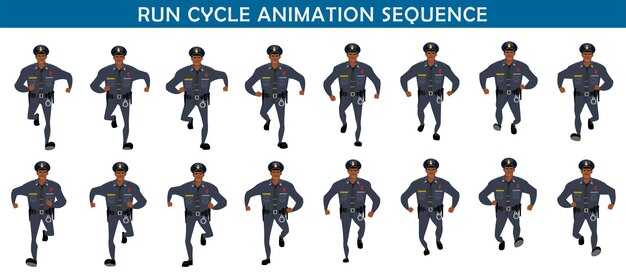

Recommendation: switch on auto retargeting to map movement data from a single camera rig onto your avatar within minutes, skipping manual rigging and enabling instant previews. This approach is designed to be accessible for solo artists and explainers in studios, keeping the workflow creative and precise, pretty reliable.

Within recent pipelines, neural tracking layers offer a premium level of accuracy, stabilizing body and limb patterns across varied lighting and occlusion. The information from camera feeds is fused into a compact representation, enabling removal of jitter and aligning data across frames. This keeps the results consistent on the page and within your asset library.

Best practices call for a lightweight 2–3 view camera setup, automatic calibration at startup, and a steady rate around 60–120 frames per second. A neural fusion stage then aligns limbs and torso to produce stable poses, enabling artists to iterate quickly and tweak only when needed. This demand on teams is reduced, helping ship scenes faster.

Designed to be accessible across studios, this workflow integrates into a documentation page and into the artists’ toolchain, featuring auto-configs that reduce setup time. For premium results, save presets for different actor types and movement patterns so teams can reuse them on every project.

Step 3 Add cinematic polish

Use a markerless multi-camera setup; apply a neural cleanup pass; publish the refined footage.

Sync iphone feeds via a shared clock; limit drift to under 5 ms. Keep zoom between 1x and 2x for main frames; crossfade between angles to preserve smoothness. Target a 24-30 fps timeline to anchor movement; apply a denoise and IK smoothing pass to remove jitter while preserving details. Plan shots as a sequence: interior lighting, actors, and props in a single take when possible, else split across two to three passes for dynamic drama. In post, focus on breath moments, pauses, and line readings to raise production value; there is room to surprise audiences by subtle tempo shifts. Aim for animated clarity in every beat.

Ensure privacy by reviewing gdpr practices for data handling; anonymize faces when publishing to social, unless consent is explicit. There are test clips named charlie in a blank scene to audition timing and pacing before final rendering. The goal: more reachable quality to create outcomes than expected by a creator, enabling production teams to publish quickly.

Use markerless data across a compact rig: phone-based stereo pair plus a distant unit; compute parallax, depth, and focus stacking to simulate cinema lensing. Surprising results can come from sliding the camera by a 0.5-1.0s zoom to create a cinematic sense of scale; then lock to the action to prevent drift. There, emphasize a moment by relying on a close-up to reveal texture during a dramatic beat.

| Aspect | Recommendation | Rationale |

|---|---|---|

| Footage source | markerless multi-camera; iphone clips | Depth cues, parallax; smoother movement |

| Timing | 24-30 fps; baseline zoom 1x-2x | Smooth rhythm; consistent cadence |

| Post-processing | neural cleanup; denoise; IK smoothing | Quality lift; preserves detail |

| Export & privacy | MP4/H.264; captions; metadata; gdpr compliant | Social readiness; privacy compliance |

Calibrate capture rig for cinematic look and consistent data

Start with a baked calibration pass using a checkerboard and grayscale targets to lock perspective, distortion, and color space across cameras. Record a 60-second sweep at 24 fps, shutter 1/48, ISO 400, color temperature 5600K, in RAW or linear. This baseline keeps the timeline clean and ensures tracking data remains dependable, which minimizes risk of drift in later takes.

-

Geometry and alignment: lock inter-camera offsets within 5 mm, verify pitch/yaw/roll within ±0.2°, and confirm the origin aligns with the production coordinate system. A precise baseline improves performance during generative passes and when switching to keyframing for gaps.

-

Optics and exposure: fix focal length, aperture, and sensor alignment for every camera. Use a distortion model and apply a single LUT; keep exposure within 1/3 stop across the set to avoid chroma shifts that complicate tracking.

-

Color management: pin white balance to a single target, profile color space (rec.709 or rec.2020 as appropriate), and bake a 3D LUT into the timeline. Include a neutral chocolate-gray card in the frame to stabilize reflections on glossy surfaces.

-

Lighting and surfaces: maintain consistent color temperature and light intensity; avoid flicker by syncing to the same power source. Ensure material finishes are matte where possible to keep highlight behavior predictable on screen.

-

Tracking readiness: verify marker visibility above 90% across the shot; preempt occlusion with an auxiliary marker layout if the subject moves near the set edges. Log any missing frames to guide post-processing.

Workflow notes: the rig should support a clean data stream that a creator can trust, whether you’re capturing a quiet scene or a massive crowd. Start by documenting the baseline, then evolve into a strong pipeline that uses generative cues and early keyframing to fill gaps without breaking continuity. There’s no need to chase perfection with every take; keep a compact set of presets to limit setup time and protect the director’s timeline from disruption.

- Establish a repeatable start point for each shoot day; re-run the bake if any parameter drifts more than a threshold (e.g., 0.5% scale change or 2 px marker error).

- Run a quick test: shoot a 10-second motion sweep, then review tracking stability and color consistency on the big screen to confirm the look is captivation-ready.

- Record a brief texture pass under varied lighting to ensure the data remains clean when the scene shifts to different environments.

After calibration, the director can trust the data pipeline to deliver a consistent visual language across shots, keeping everything aligned on the timeline and reducing post mismatches. If something feels off, check for missing calibration frames, re-bake, and re-validate the geometry–the process is simple, but the payoff is massive: a screen that stays engaging and credible from start to end.

Refine movement curves using reference footage and timing

please assemble a personal library of 3–5 reference clips that reflect target styles (gaming, indie, cinematic). weve found these anchors improve every sequence, helping creators produce exciting, crisp curves that feel natural. store this full collection for reuse across projects and make iteration faster.

Select 2–3 anchor moments from each clip: peaks, troughs, holds. Mark exact frames to build a timing map that aligns to your project’s beat grid.

Create two baseline curves: one for rhythm (overall pace) and one for expressive push. Use a simple spline or Bezier interpolation to connect keyframes, and annotate each segment with ease values (ease-in, ease-out).

Generate a per-shot timing sheet by mapping key poses to beats per minute or rhythm cues. Keep notes on tempo shifts so editors can verify alignment quickly.

Refine transitions by adjusting segment lengths so each move breathes. Apply subtle ease at every transition to avoid abrupt changes that break readability. Use a moment of anticipation to cue intent.

Iterate using playback at 0.75x and 1.25x to reveal stiffness and rhythm drift. Update curves until cadence remains consistent across scales and devices (mobile previews are especially telling).

Validate on multiple targets: test on mobile and desktop, compare against references, and ensure fidelity in full-res exports. This helps maintain quality across youtube uploads and premiere cuts.

Organize curves by favorite styles for different genres (sports, adventure, puzzle). This expands your toolkit; teammates can reuse presets to accelerate production.

Gather peer feedback and note suggestions from a small group; implement changes in a compact revision cycle. Document changes so teammates understand the reasoning behind each tweak.

By using reference footage as a guide and tight timing controls, you create movement that feels intentional and believable. This approach aims to be easy to share, easy to adjust, and easy to scale across projects, from indie experiments to bigger gaming trailers, while staying aligned with quality expectations on platforms like youtube and premiere.

Stabilize data: reduce noise, jitter, and marker drift

Begin by applying a two-stage denoising: run a low-pass filter on every marker stream, then execute a Kalman smoother across the timeline to suppress high-frequency components while keeping essential movement intact.

Verwenden Sie ein dynamisches Modell, das jeden Marker als starren Punkt behandelt und Inter-Marker-Beschränkungen erzwingt, was lebensechte Trajektorien bewahrt und das Rauschen über Sequenzen reduziert.

Ankerdriftkontrolle: Verankern Sie das Becken oder die Wurzel erneut als feste Referenz und legen Sie dann weiche Beschränkungen zwischen verbundenen Markern fest, um eine allmähliche Abweichung über die Frames hinweg zu verhindern. Hier ist ein Kontrollpunkt, um die Driftbehandlung in der Praxis zu überprüfen.

Automatisierte Bereinigung: Implementieren Sie ein Skript, das im Live- oder Batch-Modus ausgeführt wird und Bibliotheken von Drittanbietern zum Filtern, Glätten und Füllen von Lücken verwendet. Die gerenderten Ergebnisse fließen in einen sauberen Datensatz ein, der zur visuellen Überprüfung oder für Filme veröffentlicht werden kann.

Validierungsschritte: Berechnen Sie RMSE gegen eine Ground-Truth-Teilmenge, überprüfen Sie Restwerte und stellen Sie sicher, dass die lebensechte Zeitmessung auf der visuellen Zeitleiste erhalten bleibt. Melden Sie bitte große Fehler zur menschlichen Überprüfung und passen Sie die Parameter entsprechend an.

Umgang mit Okklusionen: Füllen Sie Lücken mithilfe der Trajektorienvorhersage aus angrenzenden Frames auf und vermeiden Sie das Erzeugen von Artefakten, die subtile Persönlichkeitsmerkmale verändern. Das Risiko einer übermäßigen Glättung sollte unter Kontrolle bleiben, um Drift zu beheben, ohne die Nuancen zu beeinträchtigen. Vermeiden Sie einfach eine übermäßige Glättung.

Workflow-Tipps: Dokumentieren Sie die Datenherkunft, sperren Sie Referenz-Frames und führen Sie ein Änderungsprotokoll. Anerkennen Sie diejenigen, die Referenzfilme, Skripte und Sprachnotizen vorbereitet haben. Bewahren Sie bei generativen Hinweisen eine klare Trennung vor der Veröffentlichung. Vergleichen Sie die Pipelines der Wettbewerber und gleichen Sie die Ergebnisse für Anzeigen ab. Betrachten Sie Schokoladenschichten als Analogie für die Schichtung von Resilienz. Dies hilft Videoscribes, den Prozess den Beteiligten und Interessengruppen zu vermitteln.

Live-Pipelines in der Produktion erfordern ein prägnantes Archiv getesteter Voreinstellungen: Speichern Sie große Parametersätze als gerenderte Profile, definieren Sie die Zielgenauigkeit und führen Sie einen visuellen Prüfpfad, um Probleme nach der Veröffentlichung in Filmen oder Anzeigen zu beheben.

Verbessern Sie Aufnahmen mit kontrolliertem Kamerawackeln und Tiefenhinweisen

Beginnen Sie mit der Festlegung einer stabilen Basislinie und fügen Sie Mikrowackler bei wichtigen Beats hinzu. Verwenden Sie ein kleines, zufälliges Wackelmuster: 0,3–0,8 Grad Neigung und 0,2–0,8 Sekunden pro Burst, die sich alle 1–2 Sekunden wiederholen. Halten Sie die Gesamtdrift über eine Aufnahme unter 2 Grad, um Ermüdung zu vermeiden. Beginnen Sie in einem traditionellen Setup während der Tests mit einem schweren Handheld-Rig und übertragen Sie es dann zu einem leichteren, studiogeeigneten Setup am Set, um Zeit zu sparen.

Tiefenhinweise: Schichten Sie Vordergrund, Mitte und Hintergrund, um Parallaxen zu erzeugen. Lassen Sie den Vordergrund 1,2–2,0-mal stärker bewegen als den Hintergrund. Variieren Sie die Brennweite zwischen 28 mm und 50 mm, um die Tiefe hervorzuheben. Verwenden Sie eine geringe Schärfentiefe (f/2,8–f/4), um die Ebenentrennung zu verstärken.

Platzierung und Timing: Verankern Sie das Kamerawackeln an Ereignissen auf dem Bildschirm und nicht an einer konstanten Drift. Halten Sie einen klaren Zeitplan ein, damit Sekunden der Aktion die Bursts antreiben. Kleine Änderungen im Tempo führen zu einer besseren Lesbarkeit.

Prozess und Planung: Laden Sie eine Bibliothek mit 3–5 Wackelmuster. Planen Sie deren Timing um die Aktion herum. Bewerten Sie ein paar Runden mit schnellen Checks am Set. Wenn sich ein Muster steif anfühlt, wechseln Sie stattdessen zu einer weicheren Kurve.

Qualitätskontrolle: Stellen Sie Fragen während der Überprüfungen. Hinweise des Regisseurs helfen bei der Verfeinerung. Stellen Sie sicher, dass das Ergebnis gut lesbare Tiefenhinweise auf verschiedenen Plattformen liefert. Eine YouTube-Short- oder Trailer-Sequenz zeigt, wie sich eine kontrollierte Ästhetik in der gesamten Branche niederschlägt.

Live-Speed-Tests und -Lernen: Verwenden Sie Erkennungsfunktionen, um Frames zu kennzeichnen, in denen das Wackeln die Leistung des Schauspielers maskiert. Passen Sie es entsprechend an. Das Endprodukt sollte sich animiert und dennoch natürlich anfühlen.

Geschmack und Ton: Behandeln Sie Energie wie temperierte Schokolade – vermeiden Sie heftige Stöße. Sorgen Sie für eine stetige Lockerung. Das Ergebnis wirkt zielgerichtet und filmisch.

Abschluss: Ausgehend von einem soliden Plan können Sie Ergebnisse erzielen, die sich global anfühlen. Steve kombiniert traditionelle Rigs, digitale Rauschmuster und sanfte Lockerungskurven, um einen einzigartigen Look zu erzielen.

Synchronisieren Sie das Schauspiel der Figur mit Dialogen und Sounddesign für Kohärenz

Planen Sie eine synchronisierte Pipeline: Ordnen Sie das Timing der Dialoge der Avatar-Bewegung mithilfe von Keyframing zu, gleichen Sie Atem und Mikroexpressionen aus Sprachspuren ab und laden Sie eine anpassbare Klanglandschaft, um die Kohärenz zu verbessern.

Ordnen Sie jede Geste der gesprochenen Zeile zu: Die Mund-, Kiefer- und Lippenformen sowie die Neigung des Kopfes und der Blick sollten Ton und Tempo in einem animierten Avatar widerspiegeln. Animieren Sie auch die Lippen in groben Durchgängen, pflegen Sie genaue Daten und lassen Sie sich von der Welt auf Ambiente.

Regisseure und Animatoren planen Szenen im Voraus und legen einen dramaturgischen Bogen, emotionale Beats und natürliche Pausen fest. Ein Generator kann anfängliche Lippenhinweise automatisch erstellen. Verfeinern Sie sie anschließend per Keyframing, um glaubwürdige Momente zu erzeugen, was das Tempo und die Konsistenz verbessert.

Exportformate sollten plattformübergreifend konsistent sein. Das ist eine hohe Hürde für das Team, erstellen Sie eine seitenbasierte Überprüfung für schnelle Checks und führen Sie Skalierungstests auf Geräten durch, um Timing-Drift frühzeitig zu erkennen.

Soundstrategie: Richten Sie die Sprachausgabe auf das Umgebungsdesign aus; denken Sie über Atmung, Überlappungen und nonverbale Hinweise nach. Wenn die Spannung steigt, sollte die Klanglandschaft entsprechend skaliert werden, und Ihr Ansatz hält das Tempo synchron.

Workflow-Tipps: Laden Sie stabile Daten, vertrauen Sie Ihrem Team und machen Sie sich auch Notizen für zukünftige Überarbeitungen. Fügen Sie in Ihrem Editor einen winzigen Glühwürmchen-Cue hinzu, um Timing-Fenster zu markieren. Dies hilft Animatoren zu wissen, wann sie subtile Kopfbewegungen machen müssen.

Schützen Sie ihre Daten: DSGVO-konforme Praktiken, Audit-Trails und Einwilligungserklärungen. Dieser Plan demonstriert Sorgfalt, wie eine vertrauenswürdige Richtlinie, und hilft dem Animator, zuverlässige Ergebnisse zu erzielen.

Lenkungstipp: Steve kann Asset-Importe überwachen, Formatstandards sicherstellen und Iterationen über Szenen vorantreiben, um schnellere Ergebnisse zu erzielen.