Inizia con un inventario preciso di repo, contributori, ticket, proposte di merge per stabilire una singola fonte di verità. Crea una mappa di una pagina: nome, proprietario, ultima attività, conteggio aperto, etichetta di priorità. Genera una dashboard di base entro 24 ore per monitorare i progressi; questo approccio fornisce una chiara direzione per l'intero ciclo di implementazione qui.

Stabilisci obiettivi misurabili con una cadenza di quattro settimane: riduci i ticket obsoleti del 30%, aumenta la copertura dell'automazione del 50%, realizza risparmi di 2-3 giorni-persona per ciclo. Monitora i progressi su una dashboard condivisa per ridurre gli sforzi qui.

Struttura l'etichettatura utilizzando un approccio simile all'algebra: definisci etichette per tipo, gravità, area, proprietario; calcola automaticamente i punteggi di priorità per far emergere gli elementi tramite query in linguaggio naturale. Utilizza le basi della grammatica dei tag per mantenere le query efficienti nell'interfaccia utente.

Utilizza le esperienze degli esperti per ridurre i rischi; mappa le loro esperienze in flussi di lavoro ripetibili. Uno stadio intermedio per la revisione riduce il churn prima delle proposte di merge; le routine di automazione generano coerenza tra i compiti. L'impatto sulla consegna diventa visibile in pochi giorni; l'adozione accelera con una corretta implementazione qui.

Migliora le competenze dei team attraverso lezioni mirate sulle basi più formazione di livello intermedio; Coinvolgi gli stakeholder precocemente per allinearsi sui risultati; offri micro-corsi sulla navigazione dei repository, il triage dei ticket, le revisioni delle proposte di merge. Collega l'apprendimento a compiti del mondo reale; evidenzia il valore di marketing derivante da una consegna più rapida; orienta le applicazioni verso i risultati dei clienti. Un flusso di lavoro basato su agente riduce l'overhead di carico, migliora le esperienze per tutti gli stakeholder; il risultato sono risparmi misurabili e sostenibili in tutti i dipartimenti, inclusi i servizi.

Progetto di Implementazione AI per Piattaforme di Codice

Raccomandazione: distribuisci un hub di automazione abilitato dall'AI; genera suggerimenti di triage; propone proposte di merge; redige changelog; inizia con un modulo full-stack che ingesta log di attività, esiti di revisione, feedback dei contributori; inizializza con 2 milioni di eventi da progetti passati; punta a una riduzione del 30% del tempo di ciclo in otto settimane.

Ragionamento: questa configurazione migliora le esperienze dei professionisti; aumenta l'efficienza; migliora la competitività sul mercato; supporta un'offerta di servizi solida. Per la formazione di base, applica l'apprendimento supervisionato con un piccolo set etichettato; integra segnali semi-supervisionati; mantieni la revisione human-in-the-loop per individuare errori; implementa pipeline di ricarica per aggiornamenti dei modelli; imposta framework di governance.

Progettazione della piattaforma: stack di microservizi; orchestrazione di container; nucleo AI; logging; osservabilità; automazione ispirata alla robotica; assistenti virtuali; i pattern di Google consentono ricerche rapide tra i progetti; fornisce un'API semplificata per gli sviluppatori; permette ai professionisti di personalizzare template; le metriche principali includono MTTR, tempo di ciclo; qualità del merge; template di frasi velocizzano la redazione; le configurazioni di ricaricamento si aggiornano automaticamente in base agli trigger; l'automazione supporta la gestione dell'intero ciclo di vita.

Impatto di mercato e governance: il modello fornisce un servizio scalabile per le imprese; le applicazioni in tutti i team aumentano l'efficienza; le pipeline di formazione sono allineate alla conformità. Questo progetto consente ai team di creare esperienze più velocemente; i professionisti acquisiscono flussi di lavoro ripetibili; i concetti di robotica riducono il lavoro manuale.

| Modulo | Scopo | Origini Dati | KPI |

|---|---|---|---|

| Motore di Triage | Classifica i ticket per l'instradamento agli esperti | ticket storici; esiti di revisione; etichette | tempo di ciclo; accuratezza dell'instradamento |

| Assistente Proposte | Genera proposte di merge; redige note | dati diff; commenti di revisione; feedback dei contributori | tasso di accettazione; tasso di rilavorazione |

| Generatore Changelog | Produce note di rilascio; riassume le modifiche | messaggi di commit; piani di rilascio; documenti di ambito | completezza delle note; tempo per la pubblicazione |

| Osservabilità & Governance | Monitora le prestazioni; applica le policy | log di sistema; metriche; feedback umano | conformità alle policy; deriva del modello |

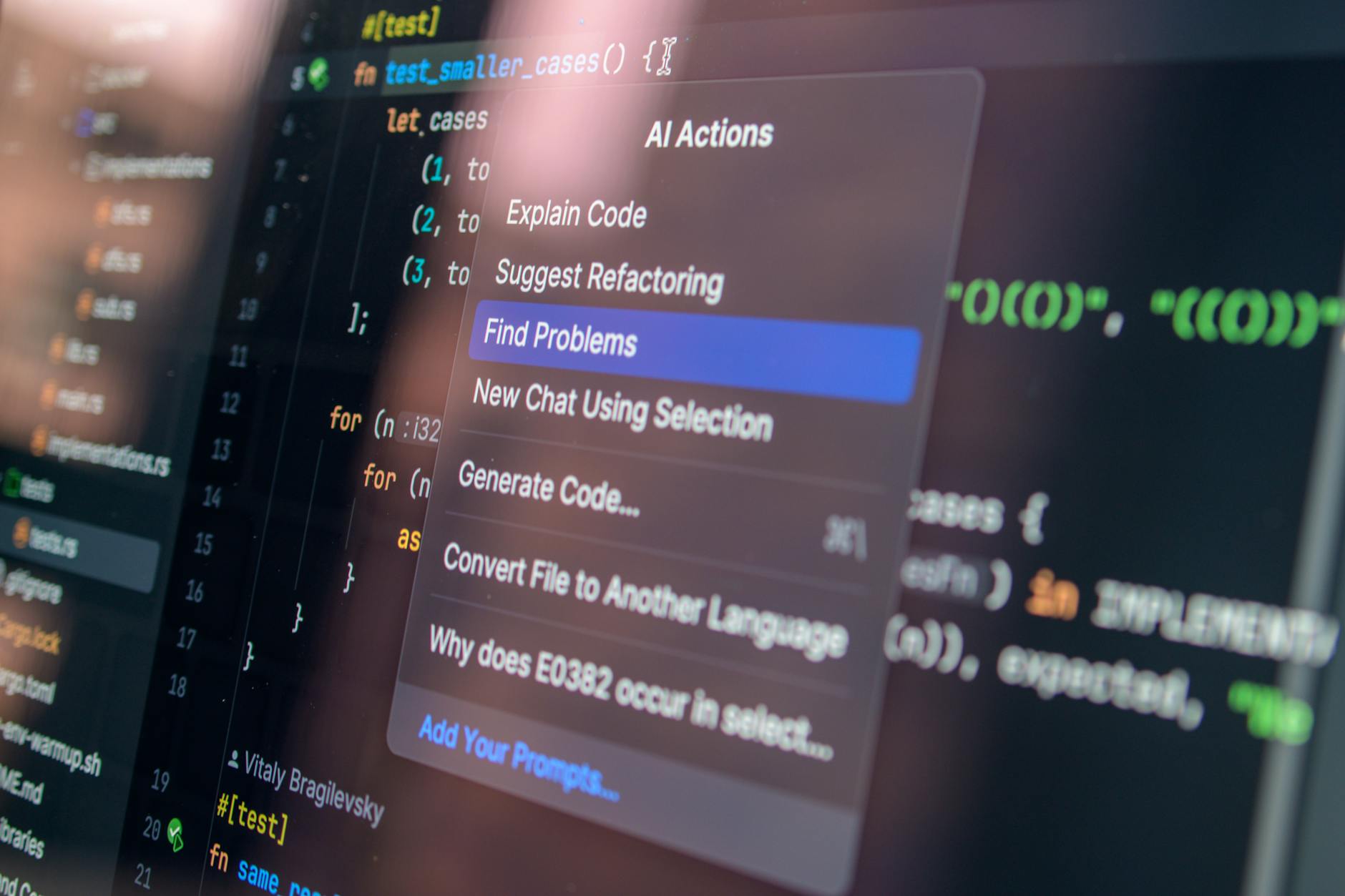

Definisci obiettivi AI chiari per la ricerca di codice, il triage delle issue e l'automazione delle PR

Inizia con una triade di set di obiettivi che guidano le azioni basate sull'AI attraverso la navigazione degli artefatti di programmazione, il triage dei ticket e l'automazione delle proposte di merge. Definisci i risultati target per dominio: pertinenza del recupero, accuratezza del triage, componibilità delle proposte. Allega soglie numeriche per precisione, richiamo; tempo di turnaround; vincoli documentali su latenza, utilizzo dei dati, privacy.

Assegna la responsabilità ai team specializzati; stabilisci una carta di governance che dettagli i criteri di successo, i percorsi di aggiornamento, i controlli sui rischi. Costruisci un framework di punteggio che traduca le analisi in azioni pratiche per studenti e operatori.

Identifica i flussi di dati dalla cronologia dei progetti, metadati dei commit, commenti di revisione, esiti dei test, contenuto della documentazione, feedback degli utenti. Mappa la freschezza dei dati allo stato aggiornato; imposta vincoli di privacy; politiche di accesso.

Specifica i punti di intervento dove atterra il feedback umano, come casi di triage ambigui, proposte di merge ad alto rischio, violazioni delle policy. Richiedi la certificazione prima dell'uso in produzione; traccia la provenienza di formatori e studenti per la responsabilità.

Scegli modelli come ranking basato sul recupero, classificazione, rilevamento di anomalie; distribuisci all'interno di uno stack modulare. Definisci i componenti: sink dati, feature store, livello del modello, suite di valutazione, servizio di monitoraggio; garantisci la tracciabilità delle decisioni di punteggio.

Stabilisci una cadenza per l'aggiornamento dei dati; l'aggiornamento dei modelli; la validazione degli output per mantenere gli assist basati sull'AI aggiornati e informati. Implementa protocolli di apprendimento continuo; controlli di red teaming; distribuzioni versionate per minimizzare la deriva.

Avvia piloti a fasi con traguardi chiari; monitora metriche come qualità del recupero, accuratezza del triage, throughput dell'automazione. Crea un ciclo di feedback dove studenti, proprietari di servizi e team di contenuti forniscano input; adatta risorse, materiali di formazione, criteri di certificazione di conseguenza.

Cataloga le origini dati da repository, issue e pull request

Questo framework guidato copre l'acquisizione da store di progetti; tracker di ticket; proposte di merge; producendo un inventario completo utilizzato dai team per insight multipiattaforma.

- Identificazione delle origini dati: store di progetti; tracker di ticket; proposte di merge; cattura id, origine, titolo, descrizione, autore, created_at, updated_at, status, etichette; categorizza per tipo; includi flag di urgenza.

- Armonizzazione dello schema: definisci uno schema catalogo unico con campi: id, source, type, origin, title, description, created_at, updated_at, status, assignees, labels; implementa una tassonomia uniforme tra le piattaforme.

- Arricchimento di metadati: aggiungi contesto come percorsi repo, proprietari, task correlati; registra link incrociati per tracciare decisioni umane; mantieni un glossario dei termini; copri un'ampia gamma di casi.

- Strategia di ingestione e ricarica: preferisci ricariche incrementali; implementa webhooks; gestisci i limiti di frequenza; pianifica pull giornalieri o orari; usa Azure Event Grid dove disponibile.

- Archiviazione e indicizzazione: archivia in un data lake o warehouse centralizzato; scegli parquet o ORC; imposta un indice di ricerca; implementa partizioni per tipo di sorgente; garantisci l'indipendenza.

- Materiali di competenza e apprendimento: fornisci tutorial; pubblica una serie di blog; fornisci notebook di esempio; consenti ai team professionali di acquisire familiarità; includi esercizi rapidi per una competenza veloce.

- Dati pronti per il modello: applica strong typing; conserva la semantica; i modelli possono classificare i tipi di sorgente; pipeline tensorflow; crea feature come last_activity, activity_rate, contributor_count.

- Benefici dell'automazione: abilita flussi di lavoro ripetibili; risparmio di manodopera; riduci la curatela manuale; imposta avvisi per anomalie; traccia metriche come copertura; misura la completezza.

- Sicurezza e governance: applica accesso minimo; mantieni log di audit; limita campi sensibili; applica politiche di conservazione dei dati; documenta best practice; delinea passaggi di conformità.

- Risultati pratici: definisci casi d'uso concreti; descrivi come i team riutilizzano i dati; cita studi di casi reali; dimostra che la copertura della piattaforma scala da piccoli progetti a configurazioni enterprise.

- Considerazioni sulla piattaforma: garantisci la compatibilità tra piattaforme come Azure; estendi ad altri ecosistemi; implementa adattatori per API diverse; mantieni un'interfaccia minima e stabile per i consumatori downstream.

- Cultura e collaborazione: condividi i risultati tramite canali Discord; allinea con le pratiche lavorative; abilita walkthrough guidati dall'uomo; mantieni la documentazione trasparente in un blog.

Conoscendo questi passaggi, i team possono mantenere un catalogo pulito che supporta le best practice; riduce gli sforzi ripetitivi; aumenta la competenza in tutto lo stack; genera risparmi.

Progetta pipeline dati e governance per supportare l'addestramento AI

Iniziare con un catalogo dati centralizzato; implementare concetti di governance formale per l'addestramento dell'IA tra origini, etichette e controlli di accesso.

Controlli di qualità dei dati sul campo; acquisizione della lineage; il monitoraggio delle frodi costituiscono componenti fondamentali della pipeline.

Iniziare con una progressione lineare dai dati grezzi ai set di addestramento curati; mantenere una rigorosa provenienza per supportare la riproducibilità.

Prevale l'automazione; le revisioni manuali sono riservate ai dati ad alto rischio; utilizzare trigger basati su policy per l'escalation.

Controlli di accesso basati sui ruoli; redazioni a livello di campo; flussi di lavoro di certificazione per i programmi mitigano le frodi; conformità ai vincoli sulla privacy.

Lo stack basato su Azure fornisce storage, calcolo, servizio di metadati; strumenti per la riproducibilità; SDK multilingue ottimizzano l'integrazione.

Archiviare campioni di codice in uno storage controllato da versioni; integrare con GitHub per pipeline automatizzate; mantenere la tracciabilità dal modulo al modello.

Pipeline multilingue supportano Python, SQL, Java/Scala; l'orchestrazione garantisce un flusso lineare dall'ingestione attraverso la trasformazione fino all'addestramento.

Le domande per iniziare includono la provenienza dei dati, gli standard di etichettatura, i vincoli sulla privacy, la gestione del ciclo di vita, la forma di responsabilità; la conduzione delle revisioni chiarisce i ruoli; quali campi sono limitati.

La governance dell'ultimo miglio produce risultati misurabili: soglie di qualità; avvisi di frode; traduzione della governance in requisiti di prodotto per le aziende che producono software; gli aggiornamenti dello stato di certificazione si allineano alla preparazione dei dati sul campo per l'addestramento; metriche concettuali per il deployment nel mondo reale; tracciare la prontezza dell'ultimo miglio con metriche esplicite.

Scegliere modelli di IA scalabili e punti di integrazione nei flussi di lavoro degli sviluppatori

Scegliere modelli pre-addestrati modulari con licenze chiare; progettare hook di deployment tramite API robuste; dare priorità ai modelli basati su transformer o ai modelli di fusione leggeri. Questo processo di boot stabilisce capacità fondamentali per flussi di lavoro scalabili nei contesti organizzativi, coprendo aziende di tutti i settori.

Mappare i punti di integrazione tramite pipeline CI, registri di container, feature store; implementare adattatori che traducano gli input del modello in API; testare i budget di latenza; verificare i percorsi di failover.

Valutare le famiglie di modelli: reti quantizzate per il throughput; distillazione per ridurre le dimensioni; schemi di recupero aumentato per compiti ad alta intensità di conoscenza.

Per i flussi di lavoro Python, utilizzare gli strumenti TensorFlow per la creazione; l'addestramento; l'ottimizzazione; il deployment. Questo crea un'esperienza user-friendly per gli sviluppatori.

Stabilire controlli di governance, privacy e regole di licenza; creare una libreria di pattern riutilizzabili accessibile ai team durante le revisioni di progettazione; allinearsi alle richieste del mercato.

Metriche di time-to-value: tracciare throughput; latenza; tempo; costo. Il throughput aumenta quando le macchine eseguono carichi di lavoro di inferenza ottimizzati; si osserveranno cicli più rapidi quando le API vengono avviate per il riutilizzo.

Pianificare il monitoraggio, la sicurezza e la conformità per il deployment dell'IA

Implementare un programma di monitoraggio automatizzato centralizzato con un framework di punteggio del rischio; far rispettare le policy, mantenere tracce verificabili; generare insight per la governance. Poiché l'automazione riduce il lavoro ripetitivo, la scalabilità diventa fattibile in modo significativamente più rapido; si concorderanno i ritmi di certificazione e addestramento, il feedback della community; le aspettative della leadership diventano chiare. Una volta che la governance raggiunge la maturità, è possibile accelerare i cicli di remediation, assegnare le responsabilità, si è pronti a costruire fiducia all'interno della community.

- Fondamenti di monitoraggio

- Definire metriche di base comuni: data drift; spostamenti della distribuzione delle feature; latenza; tassi di errore; output del modello; eventi di sicurezza. Utilizzare una dashboard user-friendly per visualizzare le tendenze.

- Stabilire una logica per il punteggio del rischio; implementare una rubrica con soglie che attivano revisioni automatizzate; tracciare i punteggi nel tempo per misurare i miglioramenti.

- Automatizzare le tracce di audit; raccogliere segnali di addestramento, log di deployment, provenienza dei dati di inferenza; conservare i registri per almeno gli ultimi 12 mesi.

- Controlli di sicurezza e resilienza

- Adottare framework come NIST CSF, CIS Controls; applicare il principio del privilegio minimo, la gestione dei segreti, la crittografia, le pratiche di codifica sicura; imporre la scansione automatizzata delle vulnerabilità attraverso le pipeline.

- Stabilire una cadenza di test ripetitiva; eseguire fuzz test, esercizi di red teaming, controlli di validazione dei dati; ruotare regolarmente chiavi e credenziali.

- Preparare playbook di risposta; definire ruoli, percorsi di escalation; esercitarsi con simulazioni ogni trimestre; generare report di incidenti per post-mortem.

- Programma di conformità e governance

- Mappare il deployment alle normative pertinenti; allinearsi agli standard di certificazione; mantenere un repository di policy vivo; tracciare le modifiche con il controllo delle versioni.

- Incorporare le basi della gestione del rischio del modello; documentare la lineage dei dati, le affermazioni e le metriche di performance; pubblicare i risultati del punteggio agli stakeholder in termini chiari.

- Costruire il coinvolgimento della community; raccogliere input da utenti e data steward; pubblicare insight trimestrali; assegnare responsabili per la remediation.

- Routine operative e proprietà

- Definire le responsabilità dell'ultimo miglio; assegnare la responsabilità della governance a un titolare designato; mantenere runbook; pianificare revisioni periodiche.

- Mantenere pipeline ripetibili; implementare IaC per la riproducibilità; utilizzare gate di test automatizzati prima delle release in produzione; pubblicare certificati al superamento dei controlli.

- Conoscere le lacune esistenti; condurre rivalutazioni del punteggio del rischio; adeguare i controlli in base alle minacce in evoluzione.